Written by WizLANSCOPE編集部

目 次

ChatGPTの「無料版」および有料版の「ChatGPT Plus」の場合、デフォルト設定では入力データが保存され、OpenAIのモデル改善のために使用される可能性があります。

つまり、機密情報や個人情報などを入力すると、意図せずに第三者への回答に個人・機密情報の一部が使用され、知らず知らずのうちに情報が漏洩してしまうというリスクが考えられます。

本記事では、ChatGPT利用時に懸念される情報漏洩リスクやその対策を解説します。

▼本記事でわかること

- ChatGPTによる情報漏洩リスク

- 実際にChatGPTの情報が漏洩した事例

- ChatGPTによる情報漏洩を回避するための対策

業務効率化のためにChatGPTを利用している、もしくは利用を検討しているという企業・組織の方は、ぜひご一読ください。

また、本記事では「ChatGPTの安全な業務利用」をサポートする「LANSCOPE エンドポイントマネージャークラウド版」についてもご紹介します。

“ChatGPT”の社内利用ルール、どう決める?

【AIサービス利用ガイドライン】を公開!

MOTEXが社内向けに作成したAIサービス利用ガイドラインをダウンロードできます。ChatGPT をはじめ、各種 AI サービスの業務利用ルール策定の参考に活用いただけます。

ChatGPT利用時の情報漏洩リスクとは

生成AIツール「ChatGPT」は、便利なツールとして急速に普及が進んでいますが、使用方法を誤ると情報漏洩のリスクを伴う注意が必要なツールです。

たとえば、文章作成や翻訳、プログラムの自動化など、ビジネスシーンでの活用も広がる一方で、適切な設定ができていないと、入力した内容が意図せずに第三者に漏洩してしまうリスクもはらんでいます。

とくに業務に関するデータや個人情報を取り扱う場面では、慎重な運用が求められます。

ここでは、ChatGPTを使う上で注意すべきChatGPTの主な情報漏洩リスクについて解説します。

入力した情報が漏洩する

ChatGPTへの入力内容が意図せず外部に流出するケースが、ChatGPTの利用で最も多い情報漏洩のケースです。

ChatGPTでは、利用者が入力したデータがシステムの学習材料として利用されます。

つまり、個人情報や企業の機密データを入力してしまうと、ほかの利用者への回答生成時にその情報が活用される可能性があるのです。

知らない間に自社の重要情報が第三者に開示されてしまう可能性があるため、入力内容の選択には十分な注意が必要です。

なお、API版を利用する場合には、入力データが学習に使用されない設定となっているため、このようなリスクを回避できます。

ChatGPTを業務で利用する際は、用途に応じて適切なサービス形態を選択する必要があります。

アカウント情報が漏洩する

ChatGPTを利用するために登録した個人情報が漏洩するケースもあります。

2023年には、ChatGPTの開発元であるOpenAIのミスによって、ChatGPTの有料版である「ChatGPT Plus」会員の個人情報漏洩事故が発生しています。

同じく2023年に、インフォスティーラーによって盗まれた10万件以上のChatGPTアカウントがダークウェブで売買されていたことも報告されています。

このような事態を防ぐためには、強固なパスワードの設定や二要素認証の活用など、基本的なセキュリティ対策を徹底することが大切です。

また、定期的なパスワード変更や不審なアクセス履歴の確認も効果的な予防策です。

チャット履歴が漏洩する

ChatGPTは過去、システムのバグによって一部利用者のチャット履歴タイトルが、ほかの利用者に誤って表示されてしまうトラブルが発生しています。

このときは、チャットの内容自体は表示されなかったものの、今後同じようなインシデントが発生しないとは言い切れません。

システムの信頼性向上は継続的に図られていますが、利用者側でも機密情報の取り扱いには十分な配慮が求められます。

そのためChatGPTを業務で利用する際には、会話内容が外部に流出した場合の影響を事前に評価し、適切な利用方針を策定する必要があります。

ChatGPTによる情報漏洩の事例

ChatGPTによる情報漏洩の事例を2件紹介します。

大手電子機器メーカーの従業員がChatGPTに機密情報を入力した事例

2023年3月、大手電子機器メーカーの従業員がChatGPTに機密情報を入力し、情報が漏洩するという事案が発生しました。

入力されたのは、設備情報や会議内容といった社内関係者しか知りえない情報であったことがわかっています。

企業側は、さらなる機密情報の流出を避けるべく、ChatGPTをはじめとする人工知能(AI)搭載チャットボットの業務利用を禁止する措置をとりました。

この件では、入力された情報が実際に第三者の回答に表示されたかどうかはわかっていません。

しかし、AIのサーバー上に保存されたデータはユーザー自身でも削除できないため、一度入力してしまえば取り消すことが困難です。

ChatGPTをはじめとする生成AIツールは、業務効率化などのメリットがある一方で、情報管理が甘い場合、重大なセキュリティ事故につながる恐れがあります。

システムのバグによって個人情報が漏洩した事例

2023年3月、ChatGPTの開発元であるOpenAIのシステムのバグにより、「ChatGPT Plus」の会員の個人情報が漏洩する事件がありました。

漏洩したのは、会員の氏名、メールアドレス、住所、クレジットカード番号の下4桁、カードの有効期限などで、一部会員に別の会員の個人情報が表示されていました。

なお、漏洩の原因となったバグはすでに修正されています。

このような万が一のバグや不具合に備え、チャット履歴を残さない設定を徹底したり、業務用途での使用を制限したりする企業も増えています。

AIを安心して業務で活用するためには、技術的な安全性とあわせて、利用ルールの整備も必要不可欠といえるでしょう。

“ChatGPT”の社内利用ルール、どう決める?

【AIサービス利用ガイドライン】を公開!

MOTEXが社内向けに作成したAIサービス利用ガイドラインをダウンロードできます。ChatGPT をはじめ、各種 AI サービスの業務利用ルール策定の参考に活用いただけます。

ChatGPTによる情報漏洩への対策

ChatGPTによる情報漏洩を回避するためには、以下のような対策が有効です。

- オプトアウト設定をおこなう

- API版を活用する

- DLPを導入する

- 法人向けプランを利用する

- 入力情報を監視する

- 自社の利用ルールの整備と周知

業務で安全にChatGPTを利用するために、情報漏洩の対策方法を詳しく確認していきましょう。

オプトアウト設定をおこなう

ChatGPTでは、入力内容をトレーニングに使用しないように設定(オプトアウト)することが可能です。

オプトアウト設定することで、意図せぬ情報漏洩を回避できる可能性が高まります。

ただし、オプトアウト設定が適用されるのは、設定後に入力された内容に限られます。

オプトアウトは、以下の2つの方法で設定できます。

- ChatGPTの設定画面から「Improve the model for everyone(すべての人のためにモデルを改善する)をオフにする方法

- 「公式サイトからオプトアウト申請」をおこなう方法

オプトアウト設定の詳しい手順は以下の記事で解説していますので、ぜひあわせてご確認ください。

API版を活用する

ChatGPTは、APIを通じて利用することもできます。

APIとは、異なるアプリケーション間でデータのやり取りをおこなうためのインターフェース技術です。

API版の利用では、入力データが学習目的で使用されることがないため、機密情報の保護レベルが大幅に向上します。

そのため、ChatGPTのAPIと自社システムを連携させることで、直接的なWeb版利用よりも安全性の高い環境でAI機能を活用できます。

さらに、自社のアプリケーション内でChatGPTの機能を統合利用することで、業務効率の改善や顧客サービスの品質向上も同時に実現可能です。

ただし、API版の導入には一定の技術的知識と開発リソースが必要になる点に注意が必要です。

企業の技術力や予算に応じて、外部の専門業者と連携しながら導入を進めることも検討する必要があるでしょう。

また、安全に利用するためには、適切なアクセス制御やログ管理の仕組みも導入時に構築する必要があります。

DLPを導入する

DLPとは、組織の機密情報を監視し、コピーや転送を制限するセキュリティソリューションです。

具体的には、特定のキーワードやデジタル指紋を用いて膨大なデータから機密情報を自動識別し、その動きを常時監することが可能です。

このDLPとChatGPTを連携することで、従業員が機密情報を入力・送信しようとした際に警告を発し、送信をブロックすることができます。

とくに規模が大きな組織の場合、人的管理だけでは限界があるため、システムによる自動制御の活用が効果的でしょう。

法人向けプランを利用する

ChatGPTには、「ChatGPT Enterprise」と「ChatGPT Team」という2つの法人向けプランがあります。

法人プランでは、業務においてChatGPTを安全に安心利用できるように、セキュリティが強化されています。

たとえば、入力データがデフォルトでトレーニングに使用されないようになっていたり、データが暗号化された状態で保存されていたりします。

ほかにも、管理者による利用状況の監視機能や、従業員のアクセス権限管理なども可能です。

ChatGPTの法人向けプランに関しては以下の記事でも解説しています。

入力情報を監視する

従業員によるChatGPTの不適切な利用を防ぐためには、入力情報の監視体制を構築する必要があります。

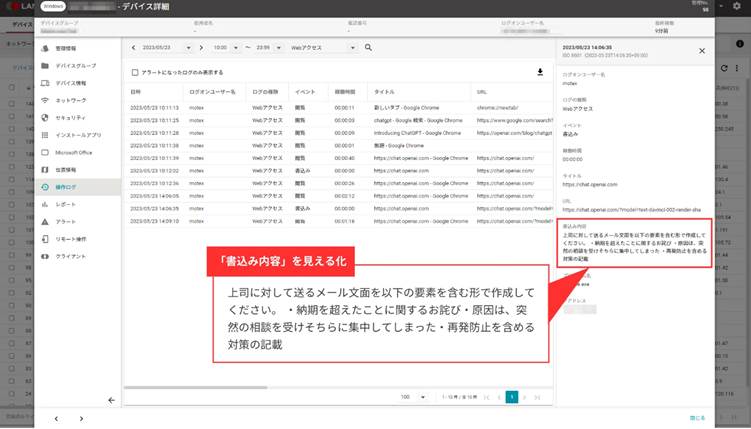

たとえば、ChatGPTでの対話履歴を「監査ログで取得」する方法が挙げられます。

対話履歴をログで残すことで、「ChatGPTへの機密情報の入力」を取り締まることが可能です。

後述する「LANSCOPE エンドポイントマネージャー クラウド版」では、従業員がChatGPTに入力した情報を、PC操作ログとして取得・把握することが可能です。

ChatGPTの業務利用を検討している企業・組織の方は、ぜひご確認ください。

自社の利用ルールの整備と周知

情報漏洩など、ChatGPTの業務利用で想定されるさまざまなリスクを回避するためには、ガイドラインの整備や周知といった対応が求められます。

デジタル庁や経済産業省など、国内主要機関が生成AI関連ガイドラインを公表しているので、自社のガイドライン整備に活用するとよいでしょう。

| デジタル庁 | テキスト生成AI利活用におけるリスクへの対策ガイドブック(α版) |

|---|---|

| 経済産業省 | AI事業者ガイドライン(第1.0版) |

| 総務省 | AI利活用ガイドライン |

| 一般社団法人ディープラーニング協会 | 生成AIの利用ガイドライン |

また、エムオーテックス株式会社(以下、MOTEX)では、Webセキュリティ専門家でEGセキュアソリューションズ取締役CTOの徳丸 浩氏が監修した『AIサービス利用ガイドライン』を提供しています。

AIサービス業務利用時の注意点・確認事項をわかりやすくまとめているため、ぜひこちらもご活用ください。

“ChatGPT”の社内利用ルール、どう決める?

【AIサービス利用ガイドライン】を公開!

MOTEXが社内向けに作成したAIサービス利用ガイドラインをダウンロードできます。ChatGPT をはじめ、各種 AI サービスの業務利用ルール策定の参考に活用いただけます。

ChatGPTの利用状況を見える化できる「LANSCOPE エンドポイントマネージャークラウド版」

生成AI利用のガイドラインを作成・周知しても、従業員が内容を理解し、守らなくては意味がありません。

そのため企業側は、ガイドラインを守って従業員が生成AIを利用しているかを確認・把握する必要があります。

MOTEX が提供するIT資産管理・MDMツール「LANSCOPE エンドポイントマネージャー」では、ChatGPTへの書き込み内容(=質問した内容)を操作ログとして取得できます※。

仮に機密情報などの不適切な情報入力があった場合は、管理者にアラートで通知されるため、迅速に対応することが可能です。

また、「ChatGPTへどのような質問をしているか」も確認できるため、ガイドラインが守られていない場合、改めてルール遵守を呼びかけるなどのアクションを起こすきっかけにもなるでしょう。

ぜひ「LANSCOPE エンドポイントマネージャー」を活用して、安全なChatGPTの利用を目指してください。

※エンドポイントマネージャー クラウド版はGoogle Chrome・Microsoft Edge・Firefox、エンドポイントマネージャー オンプレミス版はGoogle Chrome・Microsoft Edge上で「https://chat.openai.com/」「https://chatgpt.com」にアクセスし、書き込んだ内容を取得できます。

※オンプレミス版・クラウド版ともに、Windows PCのみ対応しています。

まとめ

本記事では、ChatGPTの利用時に懸念される情報漏洩リスクや対策を解説しました。

▼本記事のまとめ

- ChatGPTを利用する際は、「入力した情報の漏洩」「アカウント情報の漏洩」「チャット履歴の漏洩」などのリスクが潜んでいることを認識する必要がある

- 過去には開発元のミスで、ユーザーの個人情報が漏洩した事件も報告されている

- ChatGPTによる情報漏洩対策としては、「オプトアウト設定」「API版の活用」「法人向けプランの利用」「入力情報の監視体制の構築」などが有効である

ChatGPTは、業務の効率化などが期待できる一方で、機密・個人情報が漏洩するリスクも潜んでいます。

オプトアウト設定などの適切な対策を講じ、AIの利便性を享受しながらセキュリティを確保することを目指しましょう。

MOTEXでは、Webセキュリティ専門家でEGセキュアソリューションズ取締役CTOの徳丸 浩氏が監修した『AIサービス利用ガイドライン』を提供しています。

専門的な視点から、生成AIを業務で利用する際の注意点や確認事項をわかりやすくまとめています。ぜひご活用ください。

“ChatGPT”の社内利用ルール、どう決める?

【AIサービス利用ガイドライン】を公開!

MOTEXが社内向けに作成したAIサービス利用ガイドラインをダウンロードできます。ChatGPT をはじめ、各種 AI サービスの業務利用ルール策定の参考に活用いただけます。

おすすめ記事