Written by WizLANSCOPE編集部

目 次

「生成AIガイドライン」とは、生成AIの利用・運用における倫理的、技術的、法的なルールやベストプラクティスが定められた指針のことです。

ガイドラインを参考に、組織内における生成AIの活用ルールを見直し、従業員に正しい取り扱いを周知することで、生成AIに起因するセキュリティ事故や著作権侵害などのリスク低減が期待できます。

本記事では、生成AIガイドラインの重要性や生成AIの利用に伴うリスク、対策などをわかりやすく解説します。

また、エムオーテックス(以下、MOTEX)では、AIサービス業務利用時の注意点・確認事項をわかりやすくまとめた『AIサービス利用ガイドライン』を提供しています。 業務利用時の注意点・確認事項を専門家監修のもとまとめており、「自社・自組織のガイドライン作成の参考」として利用いただけます。

生成AIの利用方針どう決めた?

MOTEXの【AIサービス利用ガイドライン】を公開!

MOTEXが社内向けに作成したAIサービス利用ガイドラインをダウンロードできます。ChatGPTをはじめとする各種AIサービスの業務利用ルール策定の参考にご活用ください。

生成AIガイドラインとは

生成AIガイドラインとは、テキスト、画像、音声といったコンテンツを生成するAIシステム(生成AI)において、開発・運用・利用に関する原則や規範を定めたものです。

主な目的は、生成AIの活用によるメリットを最大化しつつ、プライバシーや著作権の侵害、差別、偽情報の拡散といった、潜在リスクを最小限に抑えることです。

企業の生産性向上において今や生成AIの導入は欠かせない要素ですが、従業員の不適切な運用・悪用により、誤情報の拡散や倫理的問題を引き起こすリスクも含んでいます。こうした課題に対応するため、企業・組織にて生成AIツールを導入する際には「ガイドライン」の確認や、ガイドラインの内容に遵守したポリシーや運用ルールの策定、周知といった対応が必要となります。

社内で「AIガイドライン」を定める重要性

企業が生成AIツールを導入するためには、専用の「社内向け 生成AIガイドライン」を整備することが欠かせません。生成AIにおけるリテラシーには個人差があり、各従業員の判断に任せた運用となれば、生成AIに起因するセキュリティ事故や著作権侵害などのリスクが予期されるためです。

例えば、OpenAI社の提供する生成AIツール「ChatGPT」では、ユーザーが入力した指示(プロンプト)の内容を基に、データベースの蓄積・学習が行われます。従業員が誤って「ChatGPTに機密情報を入力」すれば、社外の第三者に対する生成AIの回答に、企業機密に関する情報が含まれるリスクも想定されます。

こういったリスクを未然に防ぐには、あらかじめ企業側で「使用可能な生成AIツール」や「入力禁止の内容範囲」などを明らかにし、従業員へ周知する必要があります。生成AIガイドラインの整備は、企業が自社と従業員を守る上で欠かせない導入ステップと言えるでしょう。

生成AIに潜む様々なリスク

生成AIツールの普及により、様々な業界で効率的な作業や創造的な活動が可能になりました。しかし、生成AIツールの利用を適切に管理しなければ、以下のようなリスクを引き起こす可能性もあります。

- AI提供事業者による情報漏洩

- 著作権の侵害

- 誤情報の活用

- 他社との秘密契約(NDA)違反

情報漏洩防止のため、社内で「生成AIツールへの個人・機密情報の入力」を制限していても、生成AIツールの提供事業者側がミスすることで、情報漏洩事故が起きるリスクもあります。例えば、2023年3月にはChatGPTの開発元であるOpenAIのミスにより、ChatGPTの有料版である「ChatGPT Plus」会員の個人情報が漏洩する事故が発生しています。

また、生成AIは既存のコンテンツから学習して回答を生成するため、出力内容が既存コンテンツと酷似し、そのまま使用することで著作権の侵害を疑われるリスクもあります。

さらに、生成AIは古い情報をもとに誤った回答を出力する可能性があるため、利用時は内容の真偽をあらかじめ確認し誤情報の拡散を防止することが重要です。

生成AIの利用方針どう決めた?

MOTEXの【AIサービス利用ガイドライン】を公開!

MOTEXが社内向けに作成したAIサービス利用ガイドラインをダウンロードできます。ChatGPTをはじめとする各種AIサービスの業務利用ルール策定の参考にご活用ください。

実際に発生した生成AIによるセキュリティ事故

実際に発生した生成AIによるセキュリティ事故を2件ご紹介します。

1.従業員が機密情報であるソースコードを入力し、誤って流出させた事例

2023年3月、大手電子メーカーの従業員が機密情報をChatGPTに入力し、誤って流出させる事件が発生しました。同社がChatGPTの利用を社内で解禁したところ、従業員がソフトウェアのバグを修正する目的から、社内機密のソースコードを生成AIに入力したことが要因です。

ユーザーが生成AIに入力したデータは、OpenAI や Microsoft、Googleといったベンダーのサーバーへと一時的に保存され、早期に完全な削除を図ることは困難とされています。

この事態を受け、社内では事案の調査を進めるとともに、ChatGPTへのアップロード容量を制限する緊急措置を行い、現在はChatGPTの社内利用自体を原則禁止しています。

2.弁護士が生成AI利用により、実在しない6件の判例を誤って提出した事例

2023年5月、米東部ニューヨーク州の弁護士が民事訴訟において、実在しない判例を引用した資料を裁判所に提出する事件がありました。弁護士が提出した資料に対し、裁判所等が「判例データベースで確認できない」として指摘したところ、弁護士が ChatGPTを使って情報を収集していたことが発覚しました。

ChatGPTで生成された6件の判例は、すべて実在しないものだったとのことです。

当該弁護士は「ChatGPTに虚偽の情報が含まれている可能性に気付いていなかった」としており、今後の利用では、正当性の検証を必須とする旨を言及しています。

生成AIによるリスクを防ぐには?

生成AIによるリスクを防ぐために、企業で実施すべき対策事項は下記の通りです。

- ガイドラインの整備と周知

- 重要データは生成AIに入力しない

- 生成AIの提供する情報は、人の目で裏付けを取る

- 生成AIに有効なセキュリティサービスを導入する

ガイドラインの整備と周知

生成AIツールの利用による情報漏洩や著作権侵害、偽情報の拡散といった事態を防ぐためには、ガイドラインの整備が必要不可欠です。ガイドラインには、生成AIツール利用を許可する用途、入力可能なデータ内容、生成された文書の取り扱いなどを明記し、従業員への周知を図ります。

「ガイドラインを作成したいが、どのように手を付けるべきか分からない」という場合は、先ほど紹介した「生成AIの利用ガイドライン」などを参考に、自社向けにアレンジすると良いでしょう。 エムオーテックスの提供する「AIガイドライン」も、自社・自組織のガイドライン作成の目安としてご利用いただけます。

生成AIの利用方針どう決めた?

MOTEXの【AIサービス利用ガイドライン】を公開!

MOTEXが社内向けに作成したAIサービス利用ガイドラインをダウンロードできます。ChatGPTをはじめとする各種AIサービスの業務利用ルール策定の参考にご活用ください。

機密情報は、原則生成AIツールに入力しない

オンラインの生成AIツールに機密・個人情報を入力することは、組織として原則控えることが望ましいでしょう。

ChatGPTでは、入力内容が学習データベースに蓄積されないよう「履歴を残さない」設定に切り替えることも可能ですが、クローズドな環境以外での機密データの取り扱いは禁止することが推奨されます。

▼履歴を残さない設定方法

- ChatGPTへログイン

- Settings > Data controls > Chat history & training へ

- ONになっている「Chat history & training」の設定を、OFFへ切り替える

生成AIの提供する情報は、人の目で裏付けを取る

生成AIの出力情報はときに誤ったもの、他のWebページの内容をそのまま模倣した内容を含みます。

生成AIが提供する知見や回答を鵜呑みにせず、必ず人の目で内容を精査してから使用しましょう。

生成AIに有効なセキュリティサービスを導入する

生成AIガイドラインを整備し、社内にルールを取り決めたとしても、従業員のポリシー違反を完全に無くすことは困難です。組織はガイドラインの導入に加え、生成AIツールに有効なセキュリティ製品・サービスの導入を検討することで、情報漏洩リスクのさらなる低減が図れます。

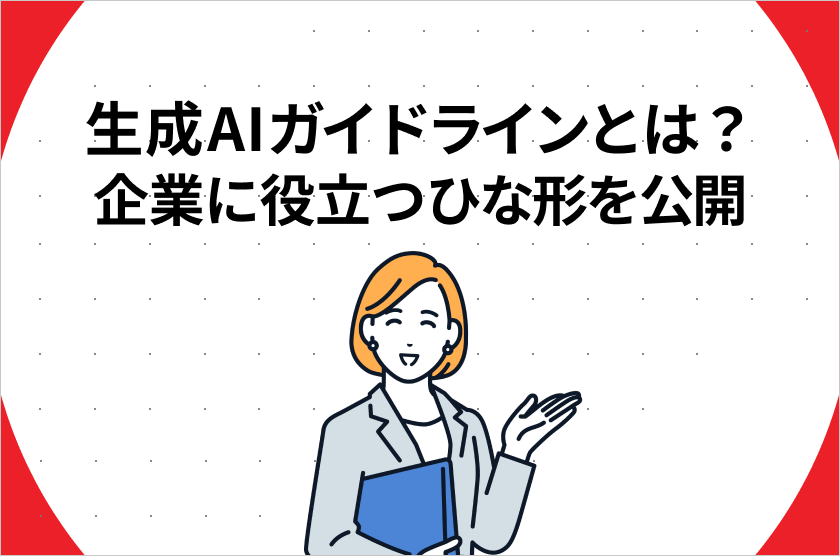

ChatGPTの利用状況を「見える化」するなら「LANSCOPE エンドポイントマネージャー クラウド版

ChatGPTのガイドラインを従業員に展開したら、次に重要となるのが「従業員が、取り決めたガイドラインを遵守しているか」をセキュリティ担当者が把握することです。

弊社が提供するIT資産管理・MDMツール「LANSCOPE エンドポイントマネージャー クラウド版」では、ChatGPTへの書き込み内容(=質問した内容)を操作ログとして取得できます※。

LANSCOPE エンドポイントマネージャーでは「誰が」「いつ」「どのデバイスで」「どんな操作をしたか」といったデバイスの利用状況を記録・可視化できるため、組織における「情報漏洩対策」や「内部不正抑止策」などに活用いただけます。

ChatGPTの利用時間を集計するだけでなく、ChatGPTに対する質問内容も合わせて把握できるため、ガイドラインに反した運用を見つけ次第、従業員に改めて注意喚起するといったアクションが可能です。

※「エンドポイントマネージャー オンプレミス版」はGoogle Chrome・Microsoft Edge、「クラウド版」はGoogle Chrome・とMicrosoft Edge・Firefox上で「https://chat.openai.com/」または「https://chatgpt.com/」にアクセスし、書き込んだ内容を取得できます。オンプレミス版・クラウド版ともに、Windows PCのみ対応しています。

MOTEXの提供する「AIガイドライン」

MOTEXでは、EGセキュアソリューションズ取締役CTOの「徳丸 浩氏」監修による、AIサービス業務利用時の注意点・確認事項をまとめた『AIサービス利用ガイドライン』を提供しています。

AIサービスを業務で利用する際の注意点・確認事項を、生成AIならではの注意点や事例も交え、専門的な視点で分かりやすくまとめており、自社・自組織のガイドライン作成の目安としていただくことができます。

AIサービスの業務利用を検討されている方、社内の指針・ルールの策定や従業員への注意喚起にお悩みのセキュリティ担当の皆さまにご活用いただければ幸いです。

<目次>

AIサービスへの入力を禁止する項目

AIサービスの応答内容を利用する際の注意点

活用場面から見るAIサービス利用の法的リスク

生成AIの利用方針どう決めた?

MOTEXの【AIサービス利用ガイドライン】を公開!

MOTEXが社内向けに作成したAIサービス利用ガイドラインをダウンロードできます。ChatGPTをはじめとする各種AIサービスの業務利用ルール策定の参考にご活用ください。

まとめ

本記事では「生成AIガイドライン」をテーマに、その概要や重要性、生成AIに潜むリスクなどを解説しました。

本記事のまとめ

- 生成AIガイドラインとは、生成AIの利用・運用における倫理的、技術的、法的なルールやベストプラクティスが定められた指針のこと

- 生成AIツールの利用においては「AI提供事業者による情報漏洩」「著作権の侵害」「誤情報の活用」「他社との秘密契約(NDA)違反」といったリスクもある

- 生成AIによるリスクを防ぐためには、ガイドラインの整備・周知とともに、「重要データは生成AIに入力しない」「生成AIの提供する情報は、人の目で裏付けを取る」「生成AIに有効なセキュリティサービスを導入するといった対策も必要

生成AIにおけるリテラシーには個人差があり、各従業員の判断に任せて運用してしまうと、生成AIに起因するセキュリティ事故や著作権侵害などが発生する恐れもあります。

業務において、生成AIツールを安全に利用するためにも、ガイドラインの整備と周知を徹底するようにしましょう。

もし「ガイドラインを作成したいが、どのように手を付けるべきか分からない」という場合は、MOTEXが提供する「AIガイドライン」をぜひご活用ください。

生成AIの利用方針どう決めた?

MOTEXの【AIサービス利用ガイドライン】を公開!

MOTEXが社内向けに作成したAIサービス利用ガイドラインをダウンロードできます。ChatGPTをはじめとする各種AIサービスの業務利用ルール策定の参考にご活用ください。

おすすめ記事