Written by WizLANSCOPE編集部

生成AIの利用方針どう決めた?

MOTEXの【AIサービス利用ガイドライン】を公開!

MOTEXが社内向けに作成したAIサービス利用ガイドラインをダウンロードできます。ChatGPTをはじめとする各種AIサービスの業務利用ルール策定の参考にご活用ください。

目 次

シャドーAIとは、企業・組織が正式に承認していないAIツールやシステムを、従業員が個人の判断で業務に利用すること、またはそのような未承認のAIツール・システムそのものを指します。

近年、個人向けに提供されている無料の生成AIが普及し、誰でも手軽に導入・活用できるようになったことで、シャドーAIが急速に拡大しています。

シャドーAIには情報漏洩やコンプライアンス違反といった企業全体に影響するさまざまなリスクが潜んでいるため、企業・組織は、社内でシャドーAIが発生しないように適切な対策を講じる必要があります。

本記事では、シャドーAIのリスクや行うべき対策を解説します。

▼本記事でわかること

- シャドーAIが拡大する理由

- シャドーAIのリスク

- シャドーAIへの対策

シャドーAIがもたらす危険性や具体的な対策方法を知りたい方は、ぜひご一読ください。

シャドーAIとは

シャドーAIとは、企業・組織が正式に承認していないAIツールやシステムを、従業員が個人の判断で業務に利用すること、またはそのような未承認のAIツールやシステム自体を指します。

生成AIは、適切に利用すれば業務の効率化に大きく寄与しますが、登場からまだ日が浅いため、従業員によっては、セキュリティリスクや法的な影響を十分に理解しないまま使っているケースも少なくありません。

そのような状態で生成AIを業務に利用してしまうと、情報漏洩などのセキュリティインシデントの発生につながりかねません。

安全な生成AIの利用を実現するためには、従業員のニーズにあった生成AIを選定することや、利用時のルールを策定することなどの対策が欠かせません。

シャドーAIが拡大する理由

シャドーAIが拡大する主な理由としては、以下が考えられます。

- 業務を効率化したいというニーズの高まり

- 個人でも手軽に導入・利用できる環境が整っている

- 生成AIの利用ルールやガイドラインが未整備になっている

- 既存の業務ツールが従業員のニーズを満たしていない

- 従業員が生成AIに潜むセキュリティリスクを把握していない

近年、生成AIの技術は急速に進化し、文章作成や資料の要約、画像生成などが高精度かつ容易に行えるようになりました。

その結果、多くの従業員が「業務を効率化したい」「作業時間を短縮したい」と考え、個人の判断でAIツールを業務に導入・利用するケースが増えています。

このように従業員側のニーズが高まる一方で、IT部門や経営陣による生成AIの利用ルールやガイドラインの整備などが追い付いていないケースが多く、その結果、現場で勝手に生成AIを利用してしまう「シャドーAI」が増加しています。

さらに、生成AIツールの多くが無料で手軽に利用できることも、シャドーAIが拡大する要因となっています。

加えて、従業員が生成AIに潜むセキュリティリスクや情報漏洩の危険性を十分に理解できていないことも、シャドーAIの拡大を助長する一因といえます。

シャドーAIとシャドーITの違い

シャドーITとは、企業や組織の正式な許可を得ずに、従業員が自己判断で業務に導入・利用するデバイスやアプリケーション、クラウドサービスなどのことを指します。

具体例として、以下が挙げられます。

- 私用のパソコンやスマートフォンを業務で使用する

- 会社が承認していないチャットサービスを業務で使用する

シャドーAIとシャドーITは、いずれも企業の正式な承認を受けずに従業員個人の判断で導入されることから、セキュリティリスクが高いという共通点があります。

しかしながら、導入対象が異なります。

シャドーITは、デバイス、アプリケーション、ネットワークサービスなど、情報システム全般に関わる範囲を対象としています。

一方でシャドーAIは、AIツールやAIサービスといった、人工知能技術に特化した領域のみを対象とします。

つまりシャドーITは、企業のIT環境そのものに関わる問題であり、シャドーAIはAI活用の利便性とリスクのバランスに関わる問題と位置付けられます。

シャドーIT・シャドーAIそれぞれの特徴は以下のように整理できます。

| 項目 | シャドーIT | シャドーAI |

|---|---|---|

| 具体例 | ・個人契約のクラウドストレージ ・フリーのWebメール ・会社が承認していないチャットツール |

・会社が承認していない画像生成AI ・会社が承認していないAI翻訳サービス |

| 発生の背景 | ・業務の利便性向上 ・組織のツールへの不満 |

・生産性の向上 ・イノベーションへの期待 |

詳しくは後述しますが、シャドーAIは、入力した機密情報が意図せずAIの学習データとして再利用され、第三者への回答に活用されてしまうといった、従来のシャドーITにはないリスクをはらんでいます。

企業・組織は、シャドーIT・シャドーAIそれぞれの特徴を理解し、それぞれに応じた適切な対策を講じる必要があります。

シャドーAIのリスク

シャドーAIによる主なリスクとしては、以下が考えられます。

- 情報漏洩

- コンプライアンス違反

- セキュリティリスクの増加

- 誤情報の拡散・業務品質の低下

- 初動対応の遅延

社内にシャドーAIが発生することで、具体的にどのようなリスクが想定されるのか解説します。

情報漏洩

AIサービスによっては、入力したデータがサービス提供元のサーバーに保存されたり、学習に利用されたりする可能性があります。

従業員がこの仕組みを認識せずに、機密情報や顧客情報などを入力してしまった場合、情報漏洩が懸念されます。

実際に過去には、従業員がChatGPTに機密情報を入力し、情報が漏洩するという事案が発生しています。

コンプライアンス違反

従業員が自身の判断で導入した生成AIに機密情報や個人情報を入力してしまった場合、個人情報保護法やGDPR(EU一般データ保護規則)などの法令に抵触する可能性があります。

また、業界ごとに定められたガイドラインや、取引先との契約で規定されるセキュリティ条件に違反するリスクも考えられます。

このようなコンプライアンス違反が発生すると、企業全体の信用やブランド価値を大きく損なう要因となり得るため、組織はシャドーAIの利用を厳重に監視・防止する必要があります。

セキュリティリスクの増加

従業員が独自の判断で導入したAIツールは、十分なセキュリティ対策が施されていない可能性があります。

セキュリティレベルが低いAIツールを業務に利用した場合、入力したデータだけでなく、利用者である従業員のアカウント情報やチャット履歴が漏洩する可能性も否定できません。

さらにこのような事態は、不正アクセスや情報資産の流出につながる恐れもあります。

誤情報の拡散・業務品質の低下

生成AIは非常に利便性の高いツールである一方で、常に正確な情報が返ってくる保証はありません。

実際、2025年10月時点のChatGPTには「ChatGPTの回答は必ずしも正しいとは限りません。重要な情報は確認するようにしてください。」と明記されています。

そのため、誤った内容や不確かな情報が回答に含まれる場合もあり、このようなデータを従業員がそのまま利用してしまうと、社内外に誤情報が拡散するリスクが生じます。

たとえば、市場分析や統計データに誤りが含まれたまま報告書として提出されれば、意思決定の誤りや業務品質の低下につながる恐れがあります。

さらに、誤情報が顧客や取引先に伝わった場合、信頼関係の悪化や企業イメージの損失といった深刻な影響を及ぼす可能性もあります。

初動対応の遅延

組織内にシャドーAIが広がると、万一トラブルが発生した際に、「誰が」「どのツールを」「どのように利用していたのか」を迅速かつ正確に把握することが難しくなってしまいます。

その結果、問題の特定や原因調査に時間を要し、顧客や取引先への説明が遅れるリスクも生じます。

こうした対応の遅れは、企業の信用低下につながり、場合によっては長期的な経営ダメージを引き起こす恐れもあります。

シャドーAI対策

シャドーAIの利用を防ぐには、以下のような対策が有効です。

- 安全に利用できるAIツールの導入

- AIの使用に関するルールの策定

- 社内用のAIの作成

- 従業員へのセキュリティ教育の実施

- 監視体制の強化

前述の通りシャドーAIの発生は、情報漏洩やコンプライアンス違反など、企業に深刻な悪影響をもたらす可能性があります。

企業・組織は、このようなリスクを未然に防ぐために、適切な対策を講じることが重要です。

5つの対策について詳しく解説します。

安全に利用できるAIツールの導入

企業・組織のセキュリティ要件を満たした安全なAIツールを導入し、業務利用を正式に承認することで、シャドーAIの発生を防止できます。

承認済みのAIツールは、情報の取り扱いやデータの保存方法、アクセス権限の管理といった仕組みが、企業のセキュリティ基準や法令に沿って設計されています。

そのため、機密情報や顧客データが外部に漏洩するリスクを大幅に抑えることが可能です。

また、正式に承認されたツールがあることで、わざわざ個人の判断で外部ツールを使う必要性も低くなります。

結果として、企業側は利用状況を把握しやすくなり、セキュリティ面と業務効率化の両立が期待できます。

AIの使用に関するルールの策定

生成AIを業務で利用する際のルールを定めたガイドラインを策定することも重要です。

例えば、以下の項目を含めたガイドラインを具体的に文書化し、従業員に周知することで、安全なAI活用につながります。

- 入力してよい情報の種類

- 利用が許可されているツールと利用目的の範囲

- 生成された成果物の扱い方

ルールが曖昧なままだと従業員は判断に迷い、結果的に誤った利用やリスクの高い行為につながりかねません。

明確なガイドラインがあれば従業員は安心してAIを活用することができ、業務効率の向上と同時に、法令や社内規程に違反する可能性も大きく減少させることができます。

ガイドラインは定期的に更新し、最新のAI技術や規制に対応できる体制を整えることも重要です。

デジタル庁や経済産業省など、国内主要機関が生成AI関連ガイドラインを公表しているので、自社のガイドライン整備に活用するとよいでしょう。

生成AIの利用方針どう決めた?

MOTEXの【AIサービス利用ガイドライン】を公開!

MOTEXが社内向けに作成したAIサービス利用ガイドラインをダウンロードできます。ChatGPTをはじめとする各種AIサービスの業務利用ルール策定の参考にご活用ください。

社内用のAIの作成

社内用に設計されたAIであれば、取り扱う情報の種類や保存方法を企業が直接管理できるため、外部サービス利用に伴う情報漏洩リスクを大幅に軽減できます。

たとえば、社内文書の検索、FAQの自動応答、定型資料の作成支援など、企業の業務に特化した機能を搭載することで、従業員の利便性を高めながら安全性を確保することが可能です。

また、利用ログの記録やアクセス制御も自社で設定できるため、問題が発生した場合の追跡や改善もしやすくなります。

こうした「社内用AI」の整備は、シャドーAIの利用を抑止すると同時に、安心して活用できる選択肢を従業員に提供する有効な施策となります。

従業員へのセキュリティ教育の実施

AIを安全に活用するためには、従業員への教育や研修も欠かせません。

シャドーAIの存在やリスク、正しい使い方について従業員に周知することで、意図せぬ情報漏洩や法令違反を未然に防ぐことができます。

特に生成AIでは、出力される情報の正確性や機密情報の取り扱いに注意が必要であることを徹底的に伝えることが非常に重要です。

監視体制の強化

監視体制を強化することで、シャドーAIによるリスクを大幅に低減できる可能性があります。

具体的には、ネットワーク監視を通じて、従業員が利用しているAIツールへのアクセス状況を可視化したり、プロンプト(入力内容)の内容を監視して、機密情報や個人情報が入力されていないかをチェックしたりといった方法が挙げられます。

また、監視体制を強化していることを従業員に周知することで、心理的な抑止効果も期待できます。

AIの業務利用は「禁止」ではなく「管理」が重要

シャドーAIへの対策を講じる際は、「全面的な禁止」ではなく、「リスクを管理しながら活用する」という視点を持つことが重要です。

生成AIは、適切に活用すれば業務効率化や生産性向上など、ビジネスに大きな革新をもたらす可能性を秘めたツールです。

一方で頭ごなしに利用を禁止してしまうと、業務効率化の機会を失うだけでなく、かえってシャドーAIを助長するというリスクが生じかねません。

そのため企業・組織は、生成AIの利便性とシャドーAIのリスクの双方を理解し、適切な管理体制を構築することが重要です。

自社だけで対策を進めるのが難しい場合は、外部の専門家の力を借りることも検討しましょう。

今後、生成AIの技術はますます進化していくことが予想されます。

企業は、生成AIを適切に管理・活用できるように、ルールやガイドラインの策定を進めましょう。

シャドーAIへの対策に「LANSCOPE エンドポイントマネージャークラウド版」

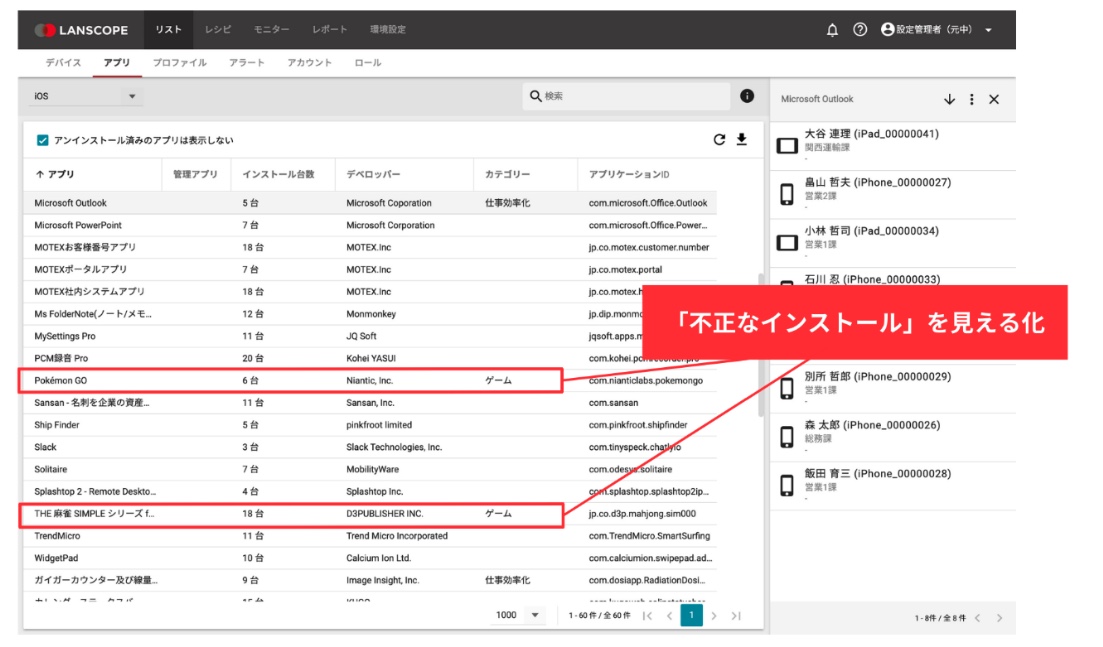

「LANSCOPE エンドポイントマネージャー クラウド版」は、PC・スマホを一元管理できるIT資産管理・MDMツールです。

従業員が使用するWebサービスやAIツールの利用状況を可視化できるため、シャドーAIへの対策にも効果を発揮します。

たとえば、インストールアプリの一覧を確認する機能や操作ログ取得機能を活用することで、どのアプリやWebサービスを利用しているかを可視化でき、従業員が利用している生成AIの実態を把握できます。

また「LANSCOPE エンドポイントマネージャークラウド版」は、ChatGPTへの書き込み内容(入力内容)を操作ログとして取得することも可能です※。

「LANSCOPE エンドポイントマネージャークラウド版」についてより詳しく知りたい方は、下記のページまたは資料をぜひご確認ください。

※エンドポイントマネージャー クラウド版はGoogle Chrome・Microsoft Edge・Firefox、エンドポイントマネージャー オンプレミス版はGoogle Chrome・Microsoft Edge上で「https://chat.openai.com/」「https://chatgpt.com」にアクセスし、書き込んだ内容を取得できます。

※オンプレミス版・クラウド版ともに、Windows PCのみ対応しています。

3分で分かる!

LANSCOPE エンドポイントマネージャー クラウド版

PC・スマホをクラウドで一元管理できる「LANSCOPEエンドポイントマネージャー クラウド版」とは?についてわかりやすく解説します。機能や特長、価格について知りたい方はぜひご活用ください。

MOTEXの提供する「AIガイドライン」

MOTEXでは、EGセキュアソリューションズ取締役CTOの「徳丸 浩氏」監修による、AIサービス業務利用時の注意点・確認事項をまとめた『AIサービス利用ガイドライン』を提供しています。

AIサービスを業務で利用する際の注意点・確認事項を、生成AIならではの注意点や事例も交え、専門的な視点で分かりやすくまとめており、自社・自組織のガイドライン作成の目安としていただくことができます。

AIサービスの業務利用を検討されている方、社内の指針・ルールの策定や従業員への注意喚起にお悩みのセキュリティ担当の皆さまにご活用いただければ幸いです。

<目次>

- AIサービスへの入力を禁止する項目

- AIサービスの応答内容を利用する際の注意点

- 活用場面から見るAIサービス利用の法的リスク

生成AIの利用方針どう決めた?

MOTEXの【AIサービス利用ガイドライン】を公開!

MOTEXが社内向けに作成したAIサービス利用ガイドラインをダウンロードできます。ChatGPTをはじめとする各種AIサービスの業務利用ルール策定の参考にご活用ください。

まとめ

本記事では、「シャドーAI」をテーマに、リスクや対策などを解説しました。

▼本記事のまとめ

- シャドーAIとは、企業・組織が正式に承認していないAIツールやシステムを、従業員が個人の判断で業務に利用すること、またはそのような未承認のAIツール・システムそのものを指す

- シャドーAIが拡大する主な理由としては、「業務の効率化」や「既存ツールへの不満」などに加え、導入のしやすさや、そもそも従業員が生成AIに潜むセキュリティリスクを把握していないことなどが挙げられる

- 社内にシャドーAIが発生すると、「情報漏洩」「コンプライアンス違反」「誤情報の拡散・業務品質の低下」といったリスクが生じる恐れがある

- シャドーAIへの対策としては、安全性やセキュリティが担保されたAIツールを導入することはもちろん、「AIの使用に関するルールの策定」「従業員へのセキュリティ教育の実施」「監視体制の強化」なども重要である

従業員が個人の判断で導入するツールの中にはセキュリティが十分でないものもあり、入力した情報が漏洩したり、それに伴いコンプライアンス違反につながったりする恐れがあります。

しかし、このようなリスクがあるからと言って、生成AIの利用を単に禁止・制限してしまうと、かえってシャドーAIを助長する可能性もあります。

そのため企業や組織は、従業員の利便性を尊重しつつ、安全にAIを活用・運用できる環境の整備に努めましょう。

本記事で紹介した「LANSCOPE エンドポイントマネージャークラウド版」は、生成AIの利用状況をはじめ、管理下にあるデバイスについて、「誰が」「いつ」「どのような操作を行なったのか」といった情報を把握することができるツールです。

また、Webセキュリティ専門家でEGセキュアソリューションズ取締役CTOの徳丸 浩氏が監修した『AIサービス利用ガイドライン』も提供しています。

生成AIの安全な業務利用に、「LANSCOPE エンドポイントマネージャークラウド版」と『AIサービス利用ガイドライン』をぜひご活用ください。

生成AIの利用方針どう決めた?

MOTEXの【AIサービス利用ガイドライン】を公開!

MOTEXが社内向けに作成したAIサービス利用ガイドラインをダウンロードできます。ChatGPTをはじめとする各種AIサービスの業務利用ルール策定の参考にご活用ください。

おすすめ記事