Written by WizLANSCOPE編集部

目 次

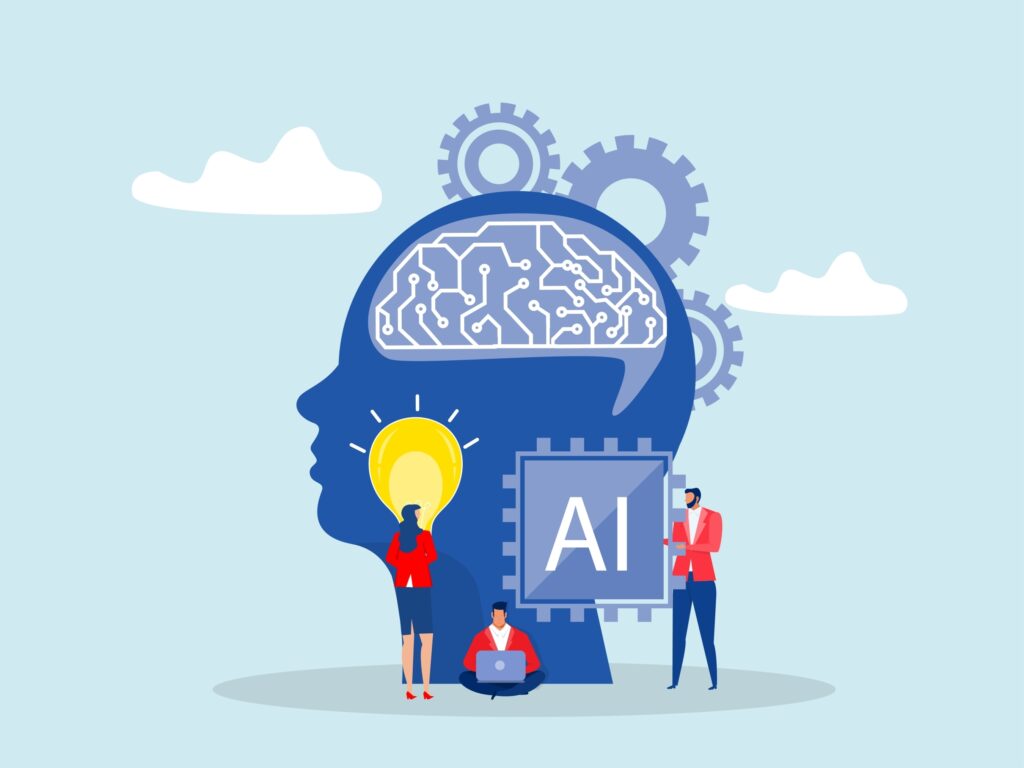

近年、ChatGPTやGeminiなどをはじめとする生成AIが急速に普及し、ビジネスや日常生活など、さまざまな場面で活用されています。

生成AIを活用した業務効率化や新たな価値創造への期待が高まっている一方で、利用する際はセキュリティリスクにも十分に考慮する必要があります。

本記事では、生成AIに潜むリスクや、生成AIを業務で安全に利用するために実施すべき対策などを解説します。

▼本記事でわかること

- 生成AIに潜むセキュリティリスク

- 生成AI利用におけるセキュリティ対策の必要性

- 生成AIを安全に利用するための対策

また、生成AIを業務で利用する際の注意点や確認事項を専門的な視点でわかりやすくまとめたガイドラインサンプルもご用意しています。

本記事とあわせてぜひご活用ください。

生成AIの利用方針どう決めた?

MOTEXの【AIサービス利用ガイドライン】を公開!

MOTEXが社内向けに作成したAIサービス利用ガイドラインをダウンロードできます。ChatGPTをはじめとする各種AIサービスの業務利用ルール策定の参考にご活用ください。

生成AIに潜む主なセキュリティリスク

まずは、生成AIに潜むセキュリティリスクへの理解を深めていきましょう。

生成AIは、文章や画像、プログラムコードなどを手軽に生成でき、業務効率化や生産性向上に大きく貢献します。

一方で、適切な管理を行わなければ、さまざまなセキュリティリスクを伴うため、利用する際は注意が必要です。

ここでは、代表的な6つのリスクを紹介します。

- 機密情報・個人情報の漏洩リスク

- 著作権・知的財産権の侵害リスク

- 誤情報・偽情報の拡散リスク

- サイバー攻撃の増加リスク

- AIモデルの脆弱性が狙われるリスク

- なりすまし・ディープフェイクによる詐欺リスク

それぞれのリスクについて、具体的な内容を確認していきましょう。

機密情報・個人情報の漏洩リスク

生成AIは、利用者が入力した情報を学習データとして利用したり、サービス提供者のサーバーに保存したりすることがあります。

そのため、生成AIに企業の機密情報(未公開の製品情報、経営戦略、顧客データなど)や個人情報(氏名、住所など)を入力してしまうと、それらの情報が意図せず外部に漏洩するリスクが発生します。

実際、過去には開発元のミスやシステムのバグによってアカウントに登録している個人情報が漏洩したり、チャット履歴タイトルが流出したりする事態も発生しています。

自分しか見ていないと思って入力した情報が、知らず知らずのうちに不特定多数の人に見られるリスクがあることを認識しましょう。

著作権・知的財産権の侵害リスク

生成AIは、インターネット上などに存在する膨大なデータを学習してコンテンツを生成します。

そのため、学習データの中に著作権で保護されたコンテンツが含まれていた場合、AIが生成したコンテンツが既存の著作物に酷似し、意図せず著作権を侵害してしまう可能性があります。

企業が生成AIを利用して作成したコンテンツ(文章、画像、プログラムコードなど)が、他者の著作権を侵害していた場合、法的問題に発展し、損害賠償請求や企業の評判低下につながる恐れもあります。

生成AIの利用規約や、生成物の商用利用に関するルールを事前に確認することが重要です。

誤情報・偽情報の拡散リスク

生成AIは、必ずしも正確な情報を生成するとは限りません。

ときには、もっともらしい嘘の情報(ハルシネーション)や、偏った見解に基づく情報を生成することがあります。

これらの誤情報や偽情報が、悪意を持って拡散された場合、社会的な混乱や経済的な損害を引き起こす恐れがあります(フェイクニュース)。

そのため、公式サイトやSNS、プレスリリースなど、企業が公式に発信する情報に生成AIを利用する場合は、生成された内容は本当に正しいのか、誤った情報が含まれていないのかなど、ファクトチェックを徹底する必要があります。

誤情報の発信源とならないように注意しましょう。

サイバー攻撃への悪用リスク

生成AIの高度な文章作成能力やコード生成能力は、悪意のある第三者によってサイバー攻撃に悪用されるケースもあります。

例えば、説得力のあるフィッシングメールの文面を大量に自動生成したり、マルウェアのプログラムコードを作成したりするのに生成AIが利用される可能性があります。

生成AIの利用拡大で、サイバー攻撃を仕掛けるハードルが下がると、攻撃の巧妙化・大規模化が進むことが懸念されます。

企業は、高度化・巧妙化、そして増加するサイバー攻撃の被害にあわないために、従業員へのセキュリティ教育を強化し、不審なメールやファイルへの警戒を怠らないようにする必要があります。

AIモデルの脆弱性が狙われるリスク

利用しているAIモデルが脆弱性を持っていた場合、不正な操作を実行されたり、機密情報が盗まれたりするリスクが高まります。

また、学習データが汚染されると、AIが誤った判断を下したり、特定の思想に偏ったアウトプットを生成したりするようになる可能性もあります。

自社でAIモデルを開発・運用する場合はもちろん、外部のAIサービスを利用する場合でも、提供元のセキュリティ対策や信頼性を評価することが重要です。

なりすまし・ディープフェイクによる詐欺リスク

画像生成AIや音声生成AIの進化により、実在の人物の顔や声を非常にリアルに模倣した「ディープフェイク」コンテンツを作成することが可能になっています。

ディープフェイクで生成したコンテンツが悪用されると、特定の人物になりすました詐欺が行われたり、虚偽の情報流出で企業の信用が損なわれたりする恐れがあります。

企業においては、役員や従業員になりすました指示による不正送金詐欺(ビジネスメール詐欺)などにディープフェイクが悪用されるリスクが考えられます。

以下の表は、ここまで説明した主なセキュリティリスクとその概要をまとめたものです。

| リスクの種類 | 概要 |

|---|---|

| 機密情報・個人情報の漏洩 | ・入力した機密情報や個人情報がAIの学習データとして利用されたり、外部に流出したりするリスク |

| 著作権・知的財産権の侵害 | ・生成AIが学習データに含まれる著作物を無断で利用し、生成物が権利を侵害するリスク |

| 誤情報・偽情報の拡散 | ・事実に基づかない情報や偏った情報を生成し、それが拡散されることで混乱や損害が生じるリスク |

| サイバー攻撃への悪用リスク | ・悪意のある第三者によってフィッシングメール作成やマルウェア開発などに生成AIが利用されるリスク |

| AIモデルの脆弱性が狙われるリスク | ・生成AI自体に脆弱性がある場合、そこを突かれて、不正な操作や情報窃取が行われるリスク |

| なりすまし・ディープフェイクによる詐欺リスク | ・生成AIで作成された偽の画像や音声が悪用され、なりすましによる詐欺や風評被害が発生するリスク |

なぜ生成AIに特化したセキュリティ対策が必要なのか

ここまで確認してきた通り、生成AIの利用に際しては、さまざまなセキュリティリスクが存在します。

では、なぜ従来型の対策に加えて、生成AIに特化したセキュリティ対策が求められているのでしょうか。

2つの観点からその理由を解説します。

従来のセキュリティ対策では十分に防げないため

従来のセキュリティ対策は、主に外部からのサイバー攻撃を防ぐことに重点が置かれています。

例えば、システムやサーバーの脆弱性を狙って仕掛けられるサイバー攻撃を防ぐために、以下のようなセキュリティソリューションが活用されています。

- ファイアウォール

- IDS/IPS

- WAF

- EDR

- 脆弱性診断・ペネトレーションテスト

これらのセキュリティ対策は、ネットワークやエンドポイント、アプリケーションのセキュリティ対策として有効です。

一方で生成AIは、AIモデルそのものの挙動や、AIとのインタラクション(対話や指示)に起因するセキュリティリスクが存在します。

生成AIのセキュリティリスクの代表例としては、以下が挙げられます。

- AIに入力する情報(プロンプト)に悪意のある指示を紛れ込ませる「プロンプトインジェクション」

- AIの学習データに由来するバイアス

- 著作権侵害

- 機密情報の意図しない露呈

これらのセキュリティリスクは、従来のネットワーク制御やマルウェア対策だけでは、十分に検知・防御できない側面があります。

そのため、ビジネスシーンで安全に生成AIを利用するためには、生成AIの特性を踏まえた専用の対策が必要とされています。

生成AI固有の脅威が報告されているため

生成AIの普及にともない、これまでにない新しいタイプの脅威が出現しています。

主な脅威として、以下のようなものが挙げられます。

| 敵対的攻撃(Adversarial Attack) | ・入力データに人間の目では判別できないほどのノイズを加えて、AIに誤った出力をさせる攻撃 |

|---|---|

| データ汚染(Data Poisoning) | ・AIの学習データに意図的に不正なデータや偏った情報を混入し、AIの性能を低下させたり、特定の結論に誘導させたりする攻撃 |

| ディープフェイク | ・実在の人物になりすました偽の動画や音声を生成し、詐欺や風評被害を引き起こす攻撃 |

| プロンプトインジェクション | ・生成AI(LLM)に対して、巧妙に設計されたプロンプトを送信することで、システムの設定や制約を回避し、不正に情報を取得したり攻撃者の意図する応答を生成させたりする攻撃 |

これらの新たな脅威は、従来のセキュリティ対策では想定されていなかったものが多く、生成AIの仕組み特性を理解した上での対策が欠かせません。

以上のことから、ビジネスシーンで安全に生成AIを利用するためには、従来型のセキュリティ対策に加え、生成AIに特化したセキュリティ対策を講じることが求められています。

企業が取り組むべき生成AIに特化したセキュリティ対策

業務で生成AIを安全に利用するためには、生成AIに特化したセキュリティ対策を講じる必要があります。

ここでは、企業・組織が取り組むべき生成AIに特化したセキュリティ対策を5つ解説します。

詳しく確認していきましょう。

利用ガイドラインの策定と周知徹底

企業・組織において業務で生成AIを利用することを許可する際は、「生成AIの利用ガイドライン」の策定が欠かせません。

「どの業務に利用していいのか」「どの業務に利用してはいけないのか」を明確にしたガイドラインを策定すると、生成AIのセキュリティリスクの低減を期待できます。

ガイドラインには、以下のような項目を記載しましょう。

- 入力して良い情報

- 入力してはいけない情報(機密情報、個人情報、未公開情報などの取り扱い)

- 生成物の著作権や知的財産権の確認方法と責任の所在

- 生成物のファクトチェックの手順と公開基準

- 利用可能なAIツールやサービスの指定(セキュリティ評価済みのもの)

- セキュリティインシデント発生時の報告・対応フロー

策定したガイドラインは、全従業員に対して研修などを通じて周知徹底し、理解と遵守を求める必要があります。

エムオーテックス株式会社(以下、MOTEX)では、生成AIを業務で利用する際の注意点や確認事項を専門的な視点でわかりやすくまとめたガイドラインサンプルをご用意しています。

ダウンロードしてぜひご活用ください。

“ChatGPT”の社内利用ルール、どう決める?

【AIサービス利用ガイドライン】を公開!

MOTEXが社内向けに作成したAIサービス利用ガイドラインをダウンロードできます。ChatGPT をはじめ、各種 AI サービスの業務利用ルール策定の参考に活用いただけます。

従業員へのセキュリティ教育とリテラシー向上

ガイドラインを策定するだけでなく、従業員一人ひとりのセキュリティ意識とリテラシーを高めるための教育も重要です。

生成AIの仕組みや利便性だけでなく、生成AIに潜む潜在的なリスクや安全に利用する方法、関連する法令や倫理的側面などについて、定期的な研修や情報提供を行うことで、セキュリティ意識を高めることができます。

特に、フィッシング詐欺やソーシャルエンジニアリングなど、生成AIが悪用されうる攻撃手法についての周知は徹底し、不審な情報に対する警戒心を養うようにしましょう。

入力データ・出力データの管理と監視体制の構築

生成AIに入力するデータと、AIから出力されるデータの管理体制の整備も徹底しましょう。

機密情報や個人情報が不用意に入力されることを防ぐためには、技術的・組織的な仕組み(例:DLPツールの導入、入力前チェックリストの運用)を導入し、管理体制を強化する必要があります。

生成されたコンテンツについては、公開前に内容の正確性、著作権侵害の有無、倫理的な問題点などを確認するプロセスを設けることで、生成AI利用にともなうセキュリティリスクを低減させることができます。

また、定期的にログを監視し、不適切な利用や異常な挙動がないかをチェックすることも重要です。

法人向けプランの導入

生成AIサービスの中には、法人向けプランが用意されているものもあります。

例えばChatGPTには、「ChatGPT Enterprise」と「ChatGPT Business(旧Team)」といった2つの法人向けプランが用意されており、個人向けプランと比べてセキュリティや管理機能が強化されています。

具体的には、入力データがデフォルトでAIモデルの学習に利用されないようになっているほか、管理コンソール機能を通じて、従業員アカウントの一元管理や利用状況の可視化、アクセス権限の設定などを行うことが可能です。

企業・組織での利用を前提としたプランを導入することで、ガバナンスを効かせながら生成AIを利用できるようになり、セキュリティリスクの低減にもつながります。

定期的なリスクアセスメントと対策の見直し

生成AIの技術は日進月歩であり、新たな脅威や脆弱性が次々と発見される可能性があります。

そのため、一度対策を講じたら終わりではなく、定期的にリスクアセスメントを実施し、自社のセキュリティ対策が現状に適合しているかの見直しを図ることが重要です。

業界動向やインシデント事例を収集し、必要に応じてガイドラインの改訂や、セキュリティツールのアップデート、従業員教育の内容更新などを行いましょう。

個人ができる生成AIセキュリティ対策

生成AIを安全に適切に利用するためには、企業・組織におけるルール整備だけでなく、実際に利用する従業員個々人のセキュリティ意識も欠かせません。

本記事では、個人ができる生成AIへのセキュリティ対策を4つ解説します。

- 機密情報や個人情報を入力しない

- 提供元が信頼できるAIサービスを利用する

- 生成する情報の真偽を必ず確認する

- 利用規約やプライバシーポリシーを確認する

企業・組織の担当者の方は、従業員へのセキュリティ教育を実施する際の参考としてください。

機密情報や個人情報を入力しない

最も基本的な対策は、生成AIに機密性の高い情報を入力しないことです。

機密性の高い情報には、顧客情報や取引先の情報など、ステークホルダーの情報だけでなく、自分自身や他人の個人情報(氏名、住所、電話番号、メールアドレス、マイナンバー、クレジットカード番号など)、勤務先の社外秘情報、パスワードなども含まれます。

無料のAIサービスでは、入力した情報がどのように扱われるか不透明なケースもあるため、特に注意が必要です。

提供元が信頼できるAIサービスを利用する

生成AIサービスを選ぶ際には、提供元の企業や組織が信頼できるかを確認しましょう。

運営元が不明確なサービスや、プライバシーポリシー、利用規約が明示されていないサービスの利用は避けるべきです。

大手IT企業や研究機関が提供しているサービスであっても、必ず利用規約を読み、データの取り扱いについて理解しておくことが大切です。

生成された情報の真偽を必ず確認する

前述した通り生成AIは、もっともらしい嘘の情報(ハルシネーション)を生成することがあります。

AIが生成した情報を鵜呑みにせず、必ず複数の情報源でファクトチェックを実施する習慣をつけましょう。

特に、重要な意思決定や情報発信に利用する場合は、慎重な検証が不可欠です。

利用規約やプライバシーポリシーを確認する

AIサービスを利用する際は、必ず事前に利用規約やプライバシーポリシーの確認を行いましょう。

例えば、「入力したデータがAIの学習に利用されるのか」「第三者に提供される可能性があるのか」「どれくらいの期間、情報が保存されるのか」など、データの取り扱いに関する項目を重点的にチェックすることが重要です。

安全な生成AI活用に「LANSCOPE エンドポイントマネージャー クラウド版」

本記事で紹介した通り、生成AIの安全な利用には、企業・組織が生成AI利用に関するガイドラインを策定し、周知を徹底することが重要です。

また、ガイドラインの展開の次に重要となるのが「従業員が、取り決めたガイドラインを遵守しているか」をセキュリティ担当者が把握することです。

MOTEXが提供するIT資産管理・MDMツール「LANSCOPE エンドポイントマネージャー」では、従業員が使用するWebサービスやAIツールの利用状況を可視化することが可能です。

例えば、インストールアプリの一覧を確認する機能や操作ログ取得機能を活用することで、どのアプリやWebサービスを利用しているかを可視化でき、従業員が利用している生成AIの実態を把握できます。

また本製品では、生成AIの中でも、ChatGPTへの書き込み内容(質問した内容)を操作ログとして取得可能です※。

ChatGPTの利用時間を集計するだけでなく、ChatGPTに対する質問内容も合わせて把握できるため、ガイドラインに反した運用を見つけ次第、従業員に改めて注意喚起するといったアクションが可能です。

ぜひ「LANSCOPE エンドポイントマネージャー」を活用して、安全なChatGPTの利用を目指してください。

※「エンドポイントマネージャー オンプレミス版」はGoogle Chrome・Microsoft Edge、「クラウド版」はGoogle Chrome・Microsoft Edge・Firefox上で「https://chat.openai.com/」または「https://chatgpt.com/」にアクセスし、書き込んだ内容を取得できます。オンプレミス版・クラウド版ともに、Windows PCのみ対応しています。

MOTEXが提供する「AIガイドライン」

MOTEXでは、Webセキュリティ専門家でEGセキュアソリューションズ取締役CTOの徳丸 浩氏が監修したAIサービス業務利用時の注意点・確認事項をまとめた「AIサービス利用ガイドライン」を提供しています。

本記事で解説した通り、企業・組織において安全に生成AIを利用するためには、従業員に対して、生成AIの利用方法やセキュリティリスクを適切に理解させる必要があります。

生成AIは、従来のサイバー攻撃とは異なるセキュリティリスクも潜んでいるため、生成AIに特化したセキュリティ対策を実施することが重要です。

「AIガイドライン」では、AIサービスを業務で利用する際の注意点・確認事項を、生成AIならではの注意点や事例も交え、専門的な視点でわかりやすくまとめています。

AIサービスの業務利用を検討されている方、社内の指針・ルールの策定や従業員への注意喚起にお悩みのセキュリティ担当の方は、ぜひご活用ください。

生成AIの利用方針どう決めた?

MOTEXの【AIサービス利用ガイドライン】を公開!

MOTEXが社内向けに作成したAIサービス利用ガイドラインをダウンロードできます。ChatGPTをはじめとする各種AIサービスの業務利用ルール策定の参考にご活用ください。

まとめ

本記事では、「生成AIにおけるセキュリティリスク」をテーマに、リスクの具体例や、企業・個人が実施すべきセキュリティ対策を解説しました。

本記事のまとめ

- 生成AIを安全に利用するためには、情報漏洩や著作権侵害、誤情報拡散、サイバー攻撃への悪用など、さまざまなセキュリティリスクが潜んでいることを正しく理解することが重要

- 生成AIに特化したセキュリティ対策が必要な理由として「従来のセキュリティ対策では、十分な検知・防御が困難」なことが挙げられる

- 生成AIを業務で安全に利用するためには、「生成AIの利用ガイドライン」を策定し、従業員へ周知・徹底を図ることに加えて、セキュリティ・管理機能が強化された法人向けプランを導入したり、定期的なリスクアセスメントと対策見直しを実施したりすることが重要

生成AIを業務で安全に利用するためには、生成AI特有のセキュリティリスクを正しく認識し、適切な対策を講じることが欠かせません。

企業・組織におけるルール整備に加えて、実際に生成AIを利用する従業員一人ひとりが適切な対策を行うことも重要です。

セキュリティ担当者は、策定したルールが遵守されているのかを定期的に確認し、継続的なセキュリティの維持・向上を図りましょう。

本記事で紹介した「LANSCOPE エンドポイントマネージャークラウド版」は、生成AIの利用状況をはじめ、管理下にあるデバイスについて、「誰が」「いつ」「どのような操作を行なったのか」といった情報を把握することができるツールです。

生成AIの安全な業務利用にぜひご活用ください。

また、「生成AIを導入したいが、どのようなルールを作っていいかわからない」「作ったガイドラインが本当に適切なのかわからない」という方に向けてWebセキュリティ専門家でEGセキュアソリューションズ取締役CTOの徳丸 浩氏が監修した『AIサービス利用ガイドライン』も提供しています。

利用方針の決め方や、ガイドライン作成のポイントも解説しているので、本記事とあわせてぜひご活用ください。

生成AIの利用方針どう決めた?

MOTEXの【AIサービス利用ガイドライン】を公開!

MOTEXが社内向けに作成したAIサービス利用ガイドラインをダウンロードできます。ChatGPTをはじめとする各種AIサービスの業務利用ルール策定の参考にご活用ください。

おすすめ記事